क्वेन, डीपसीक और अन्य अब बहुत कुछ परिभाषित करते हैं कि “अत्याधुनिक ओपन एमओई” कैसा दिखता है। संयुक्त राज्य अमेरिका में, अधिकांश कार्रवाई अन्य लोगों की चौकियों को चमकाने पर केंद्रित है।

आर्सी एआई में हम कुछ ऐसा जोड़ना चाहते हैं जो उस तस्वीर में गायब है: एक गंभीर ओपन वेट मॉडल परिवार जिसे अमेरिका में एक अमेरिकी कंपनी द्वारा शुरू से अंत तक प्रशिक्षित किया गया है, ऐसे वजन के साथ जो व्यवसायों और डेवलपर्स के पास वास्तव में हो सकते हैं।

वह परिवार है ट्रिनिटी.

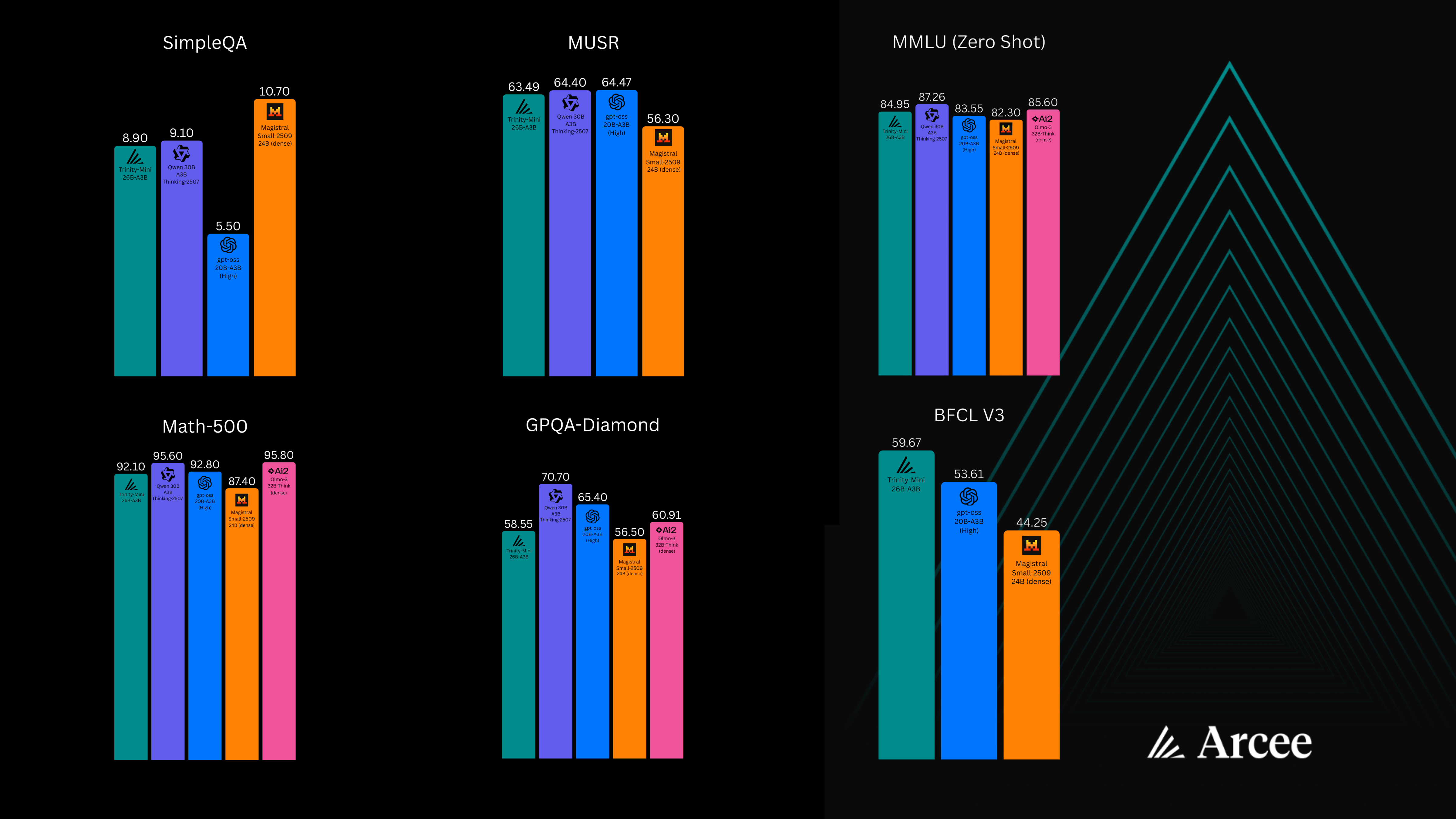

ट्रिनिटी नैनो और ट्रिनिटी मिनी अब उपलब्ध हैं।

ट्रिनिटी लार्ज वर्तमान में 2048 B300 GPU पर प्रशिक्षण ले रहा है और जनवरी 2026 में आएगा।

ट्रिनिटी मिनी हमारा पूरी तरह से प्रशिक्षित तर्क मॉडल है। ट्रिनिटी नैनो पूर्वावलोकन कुछ अलग है: एक व्यक्तित्व-फ़ॉरवर्ड चैट मॉडल जो 56 परतों और 128 विशेषज्ञों में प्रति टोकन सक्रिय केवल 800M गैर-एम्बेडिंग पैरामीटर के साथ विरलता की सीमा को आगे बढ़ाता है। यह आकर्षक है, इससे बात करना मज़ेदार है, और किनारे के मामलों में यह अस्थिर हो सकता है। यह एक प्रायोगिक रिलीज़ है, कोई सोच मॉडल नहीं। नैनो प्रीव्यू हगिंग फेस से डाउनलोड करने के लिए उपलब्ध है लेकिन हमारे एपीआई पर होस्ट नहीं किया जाएगा।

यह कहानी है कि हमने पूर्व-प्रशिक्षण पर जाने का फैसला क्यों किया, नैनो और मिनी कैसे जीवन में आए, और ट्रिनिटी आगे कहां जा रही है।

हमने प्रीट्रेनिंग का निर्णय क्यों लिया?

कुछ समय के लिए, हमारी रणनीति हर किसी की तरह लग रही थी। एक मजबूत खुला आधार लें, इसे कड़ी मेहनत से प्रशिक्षित करें, इसे उपकरण और आरएजी में तार दें और जहाज पर चढ़ा दें।

वह दृष्टिकोण हमें बहुत दूर तक ले गया। आप अच्छे आधार, सावधानीपूर्वक डेटा और उत्पाद से मेल खाने वाले निर्देश स्टैक के साथ प्रभावशाली व्यवहार प्राप्त कर सकते हैं।

साथ ही, कुछ दबाव भी बनते रहे:

- कुछ कार्यभार पर सीमा: कुछ उच्च दांव उपयोग के मामलों में, हम प्रशिक्षण के बाद पुनरावृत्ति करते रहे और स्पष्ट रूप से घटते रिटर्न देख सकते थे। विफलता के पैटर्न ने नींव में गायब क्षमताओं की ओर इशारा किया, न कि ट्यूनिंग की गलतियों की ओर।

- क्षेत्राधिकार सुरक्षा: एंटरप्राइज खरीदार तेजी से पूछ रहे हैं कि बेस मॉडल कहां से आया, इसमें कौन सा डेटा गया और कौन से लाइसेंस इसे नियंत्रित करते हैं। “हमने अज्ञात डेटा उत्पत्ति वाले एक मॉडल को ठीक किया” अनुपालन अधिकारियों को संतुष्ट नहीं करता है। एंड-टू-एंड अमेरिकी डेटा पाइप कानूनी निश्चितता प्रदान करता है जो विदेशी ब्लैक-बॉक्स मॉडल नहीं कर सकते।

- दीर्घकालिक उत्पाद दृष्टिकोण: हमारा दृढ़ विश्वास है कि दो वर्षों के भीतर, सभी सार्थक एआई एप्लिकेशन उन प्रणालियों की तरह दिखेंगे जो उन वातावरणों के अंदर विकसित होते हैं और सीखते हैं जहां उनके उपयोगकर्ता उनके साथ बातचीत करते हैं। वे प्रणालियाँ अपने स्वयं के प्रशिक्षण लूप को अनुकूलित करेंगी, और लाइव उपयोग से सीधे निर्माण और प्रशिक्षण करेंगी। उस प्रकार का सॉफ़्टवेयर बनाने के लिए आपको केवल निर्देश परत ही नहीं, बल्कि वज़न और प्रशिक्षण पाइपलाइन को भी नियंत्रित करने की आवश्यकता होती है।

हम अभी भी दूसरों के महान ओपन-सोर्स मॉडल का उपयोग करते हैं और उनकी सराहना करते हैं। हम अभी इस निष्कर्ष पर पहुंचे हैं कि यदि हम ग्राहकों को वास्तव में दीर्घकालिक, आत्म-सुधार प्रणाली प्रदान करना चाहते हैं, तो हमें अपनी स्वयं की नींव को भी प्रशिक्षित करने की आवश्यकता है।

एएफएम 4.5बी: यह साबित करना कि हम यह कर सकते हैं

हमारा पहला कदम एएफएम-4.5बी था, जो एक सघन 4.5बी मॉडल है जिसे डाटोलॉजीएआई के साथ साझेदारी में लगभग 8 ट्रिलियन क्यूरेटेड टोकन पर प्रशिक्षित किया गया है।

एएफएम-4.5बी हमारा “क्या हम ऐसा बिल्कुल कर सकते हैं” प्रयोग था:

- बड़े पैमाने पर डेटा (डेटोलॉजीएआई के साथ) और प्रशिक्षण पाइपलाइनें खड़ा करें।

- सत्यापित करें कि सावधानीपूर्वक और सुविचारित डेटा क्यूरेशन स्वच्छ स्केलिंग व्यवहार देता है।

- शुरू से अंत तक प्रशिक्षण का वास्तविक अनुभव प्राप्त करें।

इसने काम किया। एएफएम-4.5बी ने हमें प्रशिक्षण और बुनियादी ढांचे प्रथाओं का एक ठोस आधार दिया, और हमें दिखाया कि क्षमता में सुधार पर ध्यान केंद्रित करना है, खासकर गणित और कोड के आसपास।

वे पाठ सीधे ट्रिनिटी में फीड होते हैं।

एएफएम से लेकर ट्रिनिटी नैनो और मिनी तक

ट्रिनिटी हमारा ओपन वेट MoE परिवार है। हमने सीधे सीमा की ओर छलांग लगाने का फैसला किया और फिर उस लक्ष्य से पीछे की ओर काम किया, जिसका मतलब नैनो और मिनी को दो फॉर्म फैक्टर के रूप में डिजाइन करना था जो आज वास्तविक उपयोगकर्ताओं की सेवा कर सकते हैं और हमें सिखा सकते हैं कि किसी बड़ी चीज़ को कैसे प्रशिक्षित किया जाए।

- ट्रिनिटी नैनो पूर्वावलोकन: 6बी पैरामीटर एमओई (1बी सक्रिय, ~800एम गैर-एम्बेडिंग), 56 परतें, 128 विशेषज्ञ और प्रति टोकन 8 सक्रिय

- ट्रिनिटी मिनी: 26बी पैरामीटर एमओई (3बी सक्रिय), पूरी तरह से प्रशिक्षित तर्क मॉडल

दोनों को के तहत रिहा किया गया है अपाचे 2.0. हगिंग फेस से नैनो प्रीव्यू और मिनी डाउनलोड करें। मिनी हमारे एपीआई और ओपनराउटर के माध्यम से भी उपलब्ध है। नैनो पूर्वावलोकन केवल डाउनलोड के लिए है।

मूल रूप से हमने नैनो और मिनी को ट्रिनिटी लार्ज के लिए प्रशिक्षण पहियों के रूप में सोचा था। योजना हमारी MoE रेसिपी को बेहतर बनाने की थी, फिर आगे बढ़ने की थी। व्यवहार में, ये मॉडल इतने मजबूत निकले कि अब वे गंभीर उत्पादन लक्ष्य हैं:

- वे एजेंटों, उपकरणों और अन्य भारी कार्यभार के लिए तैयार किए गए कॉम्पैक्ट रीजनिंग मॉडल हैं, जिनकी औसत आउटपुट लंबाई वर्तमान निर्देश मॉडल के बराबर है।

- वे एपीआई मूल्य निर्धारण के साथ दुनिया में सबसे अधिक लागत प्रभावी मॉडलों में से कुछ हैं $0.045 / $0.15 ट्रिनिटी-मिनी मॉडल के लिए, इसके अलावा दर सीमा के साथ एक निःशुल्क टियर भी।

- वे हमारा अपना पूर्वावलोकन प्रस्तुत करते हैं चैट और एपीआई प्लेटफॉर्म पर चैट.arcee.aiजो ट्रिनिटी लार्ज की भी मेजबानी करेगा।

ट्रिनिटी वास्तुकला

हमारे एएफएम नामकरण परंपरा के आधार पर, हम इस ट्रिनिटी वास्तुकला को संदर्भित करते हैं afmoeजो एक स्वच्छ, यूएस-नियंत्रित डेटा पाइपलाइन के भीतर गेटेड अटेंशन और म्यूऑन जैसी प्रमुख वैश्विक वास्तुशिल्प प्रगति को एकीकृत करता है। यहाँ स्टैक कैसा दिखता है।

ध्यान

ध्यान तंत्र कई तकनीकों को जोड़ता है जो बड़े पैमाने पर प्रभावी साबित हुई हैं। हम समूहीकृत-क्वेरी ध्यान का उपयोग करते हैं, अनुमान के दौरान मेमोरी बैंडविड्थ को कम करने के लिए प्रत्येक कुंजी-मूल्य हेड पर कई क्वेरी हेड्स को मैप करते हैं। स्केल्ड डॉट-प्रोडक्ट ध्यान की गणना करने से पहले, हम प्रश्नों और कुंजियों (क्यूके-नॉर्म) पर आरएमएसनॉर्म लागू करते हैं, जो प्रशिक्षण को स्थिर करता है।

हम गेटेड अटेंशन का भी उपयोग करते हैं, विशेष रूप से क्वेन पेपर से G1 कॉन्फ़िगरेशन का। एसडीपीए के बाद, आउटपुट प्रक्षेपण से पहले आउटपुट को एलिमेंटवाइज-गेटेड किया जाता है: out_proj(sdpa_out * \\sigma(gate_proj(x))). यह मॉडल को प्रति-स्थिति ध्यान आउटपुट को व्यवस्थित करने की सीखी हुई क्षमता प्रदान करता है।

अंत में, हम 3:1 के अनुपात पर एक स्थानीय/वैश्विक ध्यान पैटर्न अपनाते हैं। RoPE के साथ तीन स्थानीय ध्यान परतों के बाद स्थितिगत एम्बेडिंग (NoPE) के बिना एक वैश्विक ध्यान परत आती है। यह पैटर्न दूर के संदर्भ में मॉडल की तर्क करने की क्षमता को संरक्षित करते हुए लंबे अनुक्रमों पर गणना को कम करता है।

मानकीकरण

परत सामान्यीकरण के लिए, हम गहराई-स्केल्ड सैंडविच मानदंड के सरलीकृत संस्करण का उपयोग करते हैं। प्रत्येक उपपरत गणना करती है output = x + norm(module(norm(x))) . गहराई पर स्थिर प्रशिक्षण को सक्षम करने के लिए, हम प्रत्येक मानक परत के गामा मापदंडों को आरंभ करते हैं 1/sqrt(L) जहाँ L कुल परत गणना है। हम भाषा मॉडलिंग प्रमुख के समक्ष एक मानदंड भी लागू करते हैं।

विशेषज्ञों का मिश्रण

हमारी MoE परतें DeepSeekMoE डिज़ाइन का अनुसरण करती हैं: कुशल विशेषज्ञ और एक साझा विशेषज्ञ। प्रत्येक MoE परत में कुल 128 रूटेड विशेषज्ञ होते हैं, जिनमें से 8 प्रति टोकन सक्रिय होते हैं, साथ ही 1 साझा विशेषज्ञ जो हमेशा सक्रिय रहता है। मॉडल की पहली दो परतें विरल होने के बजाय सघन हैं, जो विशेषज्ञता शुरू होने से पहले एक साझा प्रतिनिधित्वात्मक आधार प्रदान करती हैं, जिससे हमने पाया कि प्रशिक्षण स्थिरता में सुधार होता है।

रूटिंग के लिए, हम उपयोग करते हैं सिग्मॉइड रूटिंग जैसा कि डीपसीक-वी3 में पेश किया गया है। रूटिंग स्कोर की गणना सॉफ्टमैक्स के बजाय सामान्यीकरण के बाद सिग्मॉइड के साथ की जाती है। हम भी अपनाते हैं ऑक्स-लॉस-फ्री लोड संतुलन योजना: एक स्वतंत्र रूप से अद्यतन पूर्वाग्रह शब्द रूटिंग निर्णयों को निर्धारित करता है लेकिन प्रत्येक विशेषज्ञ के योगदान के लिए भार गणना से बाहर रखा जाता है। यह सहायक भार-संतुलन हानि की आवश्यकता को समाप्त करता है जो प्रशिक्षण उद्देश्य को विकृत कर सकता है।

प्रारंभ

हम मानक विचलन के साथ एक संक्षिप्त सामान्य वितरण से सभी प्रशिक्षण योग्य मापदंडों को आरंभ करते हैं 0.5/sqrt(dim). फॉरवर्ड पास के दौरान, हम एम्बेडिंग आउटपुट को गुणा करते हैं sqrt(dim).

अनुकूलक

हम माइक्रोसॉफ्ट के डायोन रिपॉजिटरी से वितरित कार्यान्वयन का उपयोग करके म्यूऑन के साथ प्रशिक्षण लेते हैं। सीखने की दरों को पैरामीटर आकृतियों में स्थानांतरित करने के लिए, हम सेट करते हैं adjusted_lr = lr * sqrt(max(1, fan_out / fan_in))जिसे हम अनुभवजन्य रूप से देखते हैं, स्केलिंग करते समय इष्टतम सीखने की दर हस्तांतरण को सक्षम बनाता है। हम एडम सीखने की दर और म्यूऑन सीखने की दर को अलग-अलग करते हैं। हम जिस सीखने की दर अनुसूची का उपयोग करते हैं वह डब्लूएसडी (वार्मअप-स्थिर-क्षय) है। हम एम्बेडिंग पर कोई भार क्षय लागू नहीं करते हैं।

आधारभूत संरचना

प्रशिक्षण बीएफ16 परिशुद्धता में टॉर्चटाइटन के संशोधित संस्करण पर चलता है। नैनो और मिनी को 4096 टोकन पर 8192 अनुक्रमों के वैश्विक बैच आकार के साथ एचएसडीपी समानता सेटअप का उपयोग करके 512 एच200 जीपीयू पर प्रशिक्षित किया गया।

प्रसंग विस्तार

हमने केवल संदर्भ विस्तार के दौरान वैश्विक ध्यान परतों का विस्तार किया, जिससे मॉडल को विस्तारित अनुक्रम लंबाई बहुत तेज़ी से सीखने की अनुमति मिली। ट्रिनिटी नैनो को 256k अनुक्रम लंबाई (128k पर अनुमान) पर प्रशिक्षित किया गया था, और ट्रिनिटी मिनी को 128k अनुक्रम लंबाई पर प्रशिक्षित किया गया था।

डेटा और प्रशिक्षण

ट्रिनिटी नैनो और मिनी ट्रेन चालू 10T टोकनउत्तरोत्तर उच्च गुणवत्ता और एसटीईएम एकाग्रता के साथ तीन चरणों में व्यवस्थित: चरण 1 में 7टी टोकन, चरण 2 में 1.8टी टोकन, और चरण 3 में 1.2टी टोकन। यह पाठ्यक्रम मॉडल को जल्दी व्यापक कवरेज बनाने और फिर उच्च-सिग्नल डेटा पर तेज करने की अनुमति देता है। मिश्रण हमारे क्यूरेटेड एएफएम डेटासेट का पुन: उपयोग करता है और काफी अधिक गणित और कोड जोड़ता है।

डेटाोलॉजी डेटा पक्ष में एक प्रमुख भागीदार बना रहा। कंप्यूट और सिस्टम पक्ष पर हमने साथ मिलकर काम किया प्रधान बुद्धि. उन्होंने न केवल सिंथेटिक डेटा उत्पन्न करने के लिए उपयोग किए जाने वाले H100 क्लस्टर डेटालॉजी की सेवा की, वे वर्तमान सहित पूरी तरह से फ्रंटियर आकार के मॉडल के लिए आवश्यक जीपीयू पदचिह्न के लिए हमारे प्रशिक्षण सेटअप को स्केल करने में मदद करने में गहराई से शामिल रहे हैं 2048 बी300 जीपीयू ट्रिनिटी लार्ज के लिए कॉन्फ़िगरेशन।

इस पैमाने पर प्रशिक्षण कठिन है

बड़े पैमाने पर एमओई प्रशिक्षण गड़बड़ है। इसे कहने का कोई विनम्र तरीका नहीं है. यह बहुत कठिन है. यहां बताया गया है कि हमने ट्रिनिटी-लार्ज के लिए कैसे तैयारी की:

- पिछले महीने से डेटाोलॉजी उत्पन्न हुई है 10 ट्रिलियन अद्वितीय सिंथेटिक टोकन उन समूहों पर जो चरम पर थे 2048 एच100 जीपीयू.

- हम उनको जोड़ते हैं 10 ट्रिलियन वेब टोकन एक निर्माण करने के लिए 20T टोकन डेटासेट

- प्राइम इंटेलेक्ट का बुनियादी ढांचा और परिचालन अनुभव यहां सिंथेटिक डेटा जेनरेशन रन से लेकर चल रहे काम तक महत्वपूर्ण रहा है 2048 बी300 जीपीयू ट्रिनिटी-लार्ज के लिए प्रशिक्षण कार्य।

काम कठिन है, लेकिन सबसे ज्यादा मजा भी यहीं है। हम जिस भी बग का पीछा करते हैं और जिस भी सीखने की अवस्था पर काबू पाते हैं वह सीधे उन मॉडलों में फ़ीड होता है जिन्हें कोई भी डाउनलोड कर सकता है और बना सकता है।

वजन का मालिक होना क्यों मायने रखता है

आगे देखने पर, हमें एक स्पष्ट पैटर्न दिखाई देता है।

जैसे-जैसे अनुप्रयोग अधिक महत्वाकांक्षी होते जाते हैं, “मॉडल” और “उत्पाद” के बीच की सीमा बढ़ती रहती है। सिस्टम होंगे:

- विशिष्ट उपयोगकर्ता आबादी के व्यवहार से सीखें।

- अन्य उपकरणों और सेवाओं के साथ बातचीत से नए कौशल विकसित करें।

वे सिस्टम प्रीट्रेनिंग डेटा, सिंथेटिक डेटा, पोस्ट ट्रेनिंग कार्यों और लाइव फीडबैक के बीच अंतर को धुंधला कर देंगे। वे उन वातावरणों में लगातार विकसित होंगे जहां उन्हें तैनात किया गया है।

इसे जिम्मेदारीपूर्वक और प्रभावी ढंग से करने के लिए, आपको वज़न और प्रशिक्षण लूप पर नियंत्रण की आवश्यकता है। आपको यह तय करने की आवश्यकता है कि मॉडल किस प्रकार का डेटा देखता है, यह किन उद्देश्यों को अनुकूलित करता है और समय के साथ इसकी क्षमताएं कैसे बदलती हैं।

ट्रिनिटी के साथ हमारा लक्ष्य उन व्यवसायों, उद्यमों और डेवलपर्स के लिए वह आधार प्रदान करना है जो ब्लैक बॉक्स के बजाय स्वामित्व चाहते हैं।

ट्रिनिटी लार्ज और आगे क्या आता है

यह सब ट्रिनिटी लार्ज की ओर ले जाता है।

- यह एक पर प्रशिक्षण देता है 20T टोकन डेटासेट, आधा सिंथेटिक और आधा वेब, डेटोलॉजी के साथ मिलकर बनाया गया है और प्राइमइंटेलेक्ट के कंप्यूटर बुनियादी ढांचे द्वारा समर्थित है।

- यह नैनो और मिनी के समान कोर MoE रेसिपी का उपयोग करता है, जो पूरी तरह से फ्रंटियर आकार के कॉन्फ़िगरेशन तक विस्तारित है।

- अभी ट्रेनिंग रन चल रहा है 2048 बी300 जीपीयूलक्ष्यीकरण रिलीज इन जनवरी 2026.

इस पोस्ट के अधिकांश भाग में हमने अंतिम आकार का नाम बताए बिना सिद्धांतों, डेटा और आर्किटेक्चर के बारे में बात की है।

ट्रिनिटी लार्ज एक 420बी पैरामीटर मॉडल है जिसमें प्रति टोकन 13बी सक्रिय पैरामीटर हैं।

नैनो और मिनी इसे संभव बनाने के लिए मौजूद हैं, और समुदाय को बड़ी ट्रेनों के दौरान उपयोग करने के लिए मजबूत खुले मॉडल प्रदान करते हैं।

जब ट्रिनिटी बड़े जहाज, हम एक पूर्ण तकनीकी रिपोर्ट जारी करेंगे जिसमें बताया जाएगा कि कैसे हम केवल छह महीनों में 4.5 बी सघन मॉडल से एक खुले सीमांत एमओई तक पहुंच गए।

ट्रिनिटी नैनो और मिनी को आज ही आज़माएँ

यदि आप खुले वजन वाले मॉडलों की परवाह करते हैं, और आप एक अमेरिकी एमओई परिवार चाहते हैं जो पूरी तरह से अनुमोदक रहते हुए सीमा पर अपना लक्ष्य रखता है, तो हम आपको आज ही ट्रिनिटी के साथ काम करना शुरू करने के लिए आमंत्रित करते हैं।

उन्हें तोड़ो. उन्हें धकेलें। हमें बताएं कि वे कहां चमकते हैं और, इससे भी महत्वपूर्ण बात यह है कि वे कहां असफल होते हैं। वह फीडबैक ट्रिनिटी लार्ज और उसके बाद आने वाली हर चीज़ को आकार देगा।

हम ये मॉडल इसलिए बना रहे हैं ताकि आप इन्हें अपना सकें।

<a href